Eines der wichtigsten Buzzwords im Marktforschungs- und Wissenschaftsjahr 2012 ist mit Sicherheit “Big Data”. Sogar die Zukunft eines Intenretriesen wie Yahoo! wird auf diese Frage zugespitzt: Wie hältst du es mit den großen Daten (dazu auch lesenswert das AdAge-Interview mit dem neuen CEO Scott Thompson)?

Auf den ersten Blick ist das Phänomen, das sich dahinter verbirgt, nichts neues: es gibt riesige Mengen an Daten, die darauf warten, analysiert und interpretiert zu werden. Diese Datenberge gab es früher auch schon – man denke nur an die gewaltigen Kundentransaktionsdaten, die klassischen Webzugriffslogs oder die Himmelsdaten aus den Observatorien.

Besonders spannend sind folgende Entwicklungen und Dimensionen des Big-Data-Phänomens:

Demokratisierung der Technik: Zum einen sind die Werkzeuge, um Datensätze in Terabytegröße zu analysieren, mittlerweile demokratisiert. Jeder, der ein paar alte Rechner im Keller stehen hat, kann daraus ein leistungsfähiges Hadoop-Cluster aufbauen und damit in die Analyse großer Daten einsteigen. Die Software, die man für Datenerfassung, Speicherung, Analyse und Visualisierung benötigt, ist größtenteils frei verfügbare Open-Source-Software. Wer zu Hause keine Rechner herumstehen hat, kann sich die Rechenzeit bei Amazon kaufen.

Ein neues Ökosystem: Mittlerweile hat sich hier eine lebendige Bastlerszene der Big-Data-Hacker entwickelt, die an den verschiedenen Big-Data-Technologien arbeitet und in Präsentationen und Aufsätzen die unterschiedlichen Anwendungsszenarien demonstrieren. Wenn man sich die Biographien der Big-Data-Community ansieht, fällt aber auch, dass man es sehr viel weniger mit Forschergruppen an Universitäten zu tun hat, sondern um Wissenschaftler (“data scientists”), die in den großen Internetunternehmen wie Google, Yahoo, Twitter oder Facebook arbeiten. Das ist zum Beispiel bei der Python-Entwicklergemeinde oder der R-Statistikercommunity anders. Im Augenblick sieht es sogar so aus, als verliefe der typische Karrierepfad an der US-Westküste weg von den Internetgiganten und hin zu neuen Big-Data-Startups.

Visualisierung von Netzwerken: Die visuelle Darstellung der Daten ist mittlerweile fast wichtiger geworden als klassische statistische Methoden, die nach Kausalitäten suchen. In diesem Zusammenhang hat auch die Netzwerkanalyse wieder stark an Bedeutung gewonnen. Fast alle soziale Phänomene und großen Datensätze von Venture Capitalists bis Katzenbildern können als Netzwerke visualisiert und exploriert werden. Auch hier spielen Open-Source-Software und offene Datenschnittstellen eine große Rolle. Programme wie die Netzwerkvisualisierungssoftware Gephi können sich in naher Zukunft direkt mit den Schnittstellen (APIs) der Plattformen Facebook, Twitter, Wikipedia oder Google verbinden und die abgerufenen Daten gleich weiterverarbeiten.

Neue Fähigkeiten und Stellenbeschreibungen: Eines der heißesten Buzzwords in der Big-Data-Szene ist der “Data Scientist”, der jetzt in klassischen Unternehmen genauso wie in Internetunternehmen für die Erhebung und Auswertung der anfallenden Daten sorgen soll. Auf Smart Planet habe ich eine gute Beschreibung der Fertigkeiten dieser “Datenjobs” gefunden: 1) Die Systemadministratoren, die sich mit Aufsetzen und Wartung der Hadoop-Cluster befassen und sicherstellen, dass der Datenfluss nicht gebremst wird. 2) Die Entwickler (oder “Map-Reducer”), die Anwendungen entwickeln, mit denen die Daten aus den Datenbanken abgerufen und verarbeitet werden. 3) Die eigentlichen Datenwissenschaftler oder Analysten, deren Aufgabe es ist, mit den Daten Geschichten zu erzählen und aus ihnen Produkte und Lösungen zu entwickeln. 4) Die Datenkuratoren, die für die Qualitätssicherung und Verknüpfung der Daten zuständig sind.

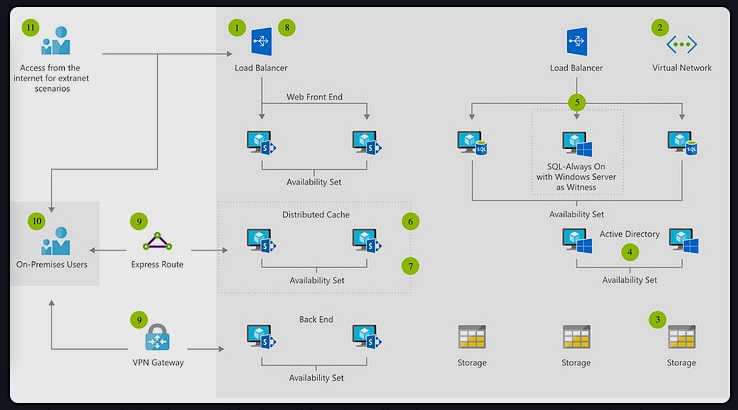

Um einen besseren Eindruck davon zu gewinnen, wie sich die Big-Data-Community selbst sieht, habe ich die Twitter-Kurzbiographien der 200 wichtigsten Big-Data-Analysten, -Entwickler, -kaufleute einer Netzwerkanalyse unterzogen: Ich habe die Kurztexte in ein Netzwerk transformiert, in dem die Begriffe die Knoten darstellen und gemeinsame Erwähnungen in einer Twitter-Bio die Kanten. Das heißt, jedes mal, wenn jemand in seiner Bio “Hadoop Committer” stehen hat, gibt es in dem Netzwerk eine neue Kante zwischen “Hadoop” und “Committer”. Insgesamt besteht dieses Netzwerk aus knapp 800 Begriffen und 3200 Verbindungen zwischen den Begriffen. Das Netzwerk habe ich dann auf ca. 15% des Umfangs reduziert, indem ich mich auf die am häufigsten verwendeten Begriffe konzentriert habe (z.B. Big Data, Founder, Analytics, Cloudera, Apache, Committer, Hadoop, Computer). Das mit Gephi visualisierte Ergebnis ist oben zu sehen.